旅行中如何缓解脊椎疲劳的有效方法

在旅行中防止脊椎疲劳的关键在于保持良好的姿势和适当的休息。避免长时间保持同一姿势,如长时间低头看手机或长时间坐立不动。适时伸展和放松肌肉,进行简单的脊椎运动。合理安排行程,避免过度疲劳。选择舒适的座椅和床铺,以减轻脊...

旅行中的心理健康挑战应对策略

旅行中的心理健康挑战可通过多种方式应对。保持积极心态,适应新环境,尝试欣赏旅途中的美景和文化差异。保持良好的作息和饮食习惯,避免过度疲劳。与同行者保持沟通,分享感受和困扰,或寻求当地人的建议和帮助。进行适量的运动和放...

旅行中如何避免体力过度消耗指南

在旅行中避免体力过度消耗的关键在于合理安排行程,确保充足的休息。旅行者应该根据自身的体力和健康状况,选择适合自己的景点和活动。避免长时间步行或爬山,适时休息并补充水分和能量。保持良好的饮食习惯,摄入足够的营养也是避免...

旅行中如何维持健康体态的秘诀

在旅行中保持健康体态的关键在于合理安排行程,注意饮食和适度运动。遵循健康饮食原则,摄入均衡营养,避免过度油腻和垃圾食品。保持规律的作息,避免熬夜和过度疲劳。利用旅行中的空闲时间进行适度的运动,如散步、跑步或参加当地的...

长途旅行心理疲劳避免策略与技巧

摘要:长途旅行中,心理疲劳是常见的问题。为避免这种情况,建议保持积极心态,进行适当休息和放松,如听音乐、阅读、深呼吸等。与同行者交流、分享旅行感受,或欣赏沿途风景,都能有效缓解心理疲劳。合理规划行程,避免过度疲劳,也...

旅行中预防食欲不振的方法与策略

旅行中预防食欲不振,需注意饮食卫生,避免油腻重口味食物,适量饮水保持水分充足。保持规律作息,避免过度疲劳影响食欲。适量运动有助于促进新陈代谢,增加食欲。若遇到不适,及时就医,避免药物影响食欲。合理调整旅行中的生活习惯...

旅行中的伤口与划痕处理指南

旅行中遇到小伤口和划痕是常见情况,不必过于惊慌。本文提供简易处理指南:清洁伤口,可用流动清水或消毒湿巾;如伤口轻微出血,可先用干净纱布或手帕轻压止血;然后使用碘伏或消毒液消毒,并涂抹抗菌药膏;用创可贴或纱布包扎。若伤...

旅行中避免皮肤晒伤问题的关键策略

摘要:旅行中避免皮肤晒伤问题至关重要。为保持肌肤健康,旅行者应采取一系列防晒措施,包括涂抹防晒霜、穿戴遮阳帽和防晒衣物,以及避免在阳光强烈时外出。保持充足的水分摄入,携带保湿喷雾和冷敷物品,有助于缓解皮肤晒后不适。遵...

旅行中的身体保护指南

旅行中做好身体保护工作至关重要。出行前需充分了解目的地气候、环境,备好必要药物。旅途中,保持良好作息和饮食习惯,适量运动,避免过度疲劳。注意个人卫生,避免接触传染病源。如遇不适,及时就诊。旅行中要注重预防,做好身体保...

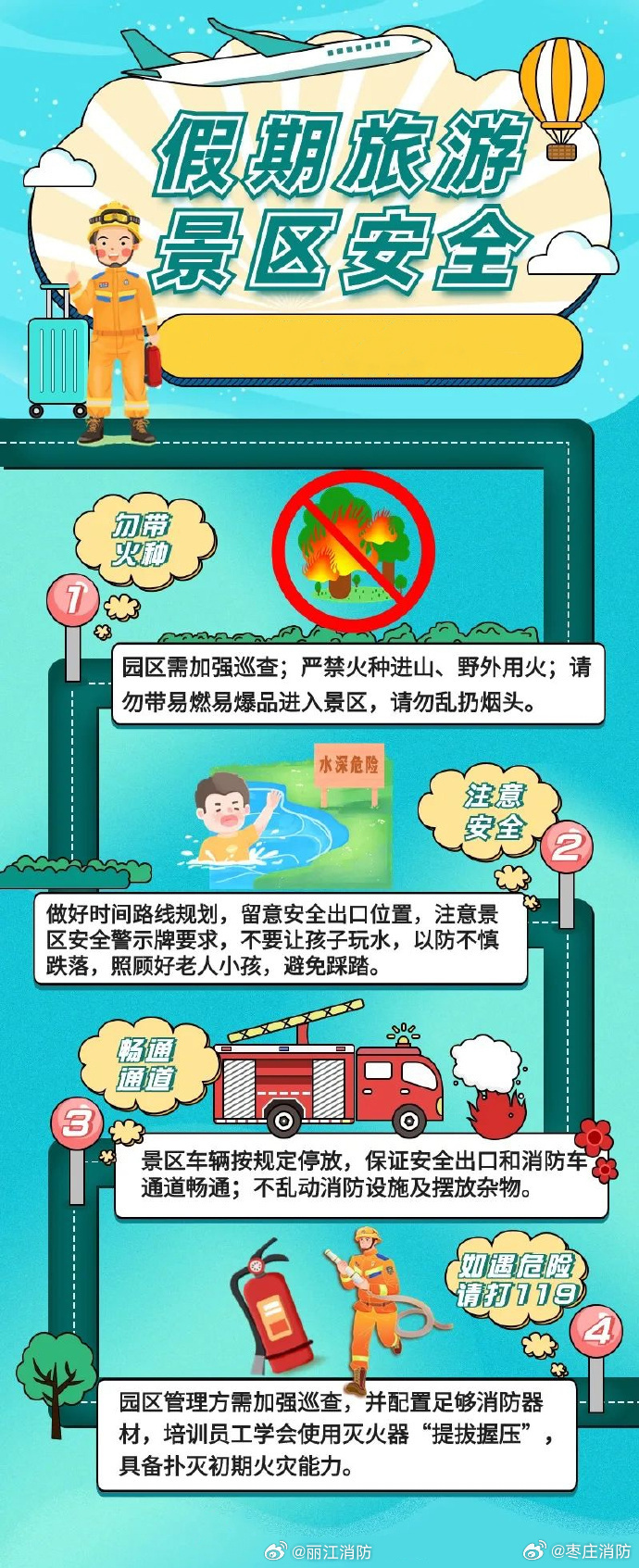

旅行安全准备攻略,如何全面做好出行前的安全防护措施

做好旅行中的安全准备工作至关重要。提前了解目的地文化、气候和潜在风险,并购买合适的旅行保险。检查个人证件、资金及电子设备,确保行李安全。出行前保持良好的身体状态,备好常用药品和急救用品。旅途中遵守交通规则,注意人身安...

沪ICP备16040027号

沪ICP备16040027号